Opracowała: Natalia Jurkiewicz, 25.11.2023 r.

Słownik pojęć

Algorytm rekomendacji –szereg czynników mapujących i rozpoznających zachowania użytkownika czy interakcje, w jakie wchodzi, m.in.: jakie konta obserwuje, a które ukrywa czy usuwa z listy obserwowanych, jakie i gdzie zamieszcza komentarze, którym treściom poświęca uwagę i reaguje na nie, a jakie są dla niego mało interesujące, które materiały udostępnia, kiedy i ile czasu korzysta z platformy, ile czasu poświęca na obejrzenie treści, czy ogląda materiał do końca, jakie materiały generuje na swoim koncie. Algorytm zbiera, analizuje i wykorzystuje informacje, które użytkownicy platformy wpisują w wyszukiwarkę – jakie materiały zostały przez nich wybrane i obejrzane, jakie elementy użytkownik oznaczył jako interesujące, jakie dźwięki, efekty specjalne, hasztagi czy trendy zyskują szybko na popularności i są obiektem wielu interakcji. Analizie algorytmu poddawane są również informacje o używanym urządzeniu (język, region użytkowania, model telefonu).

Instagram –platforma społecznościowa, która opiera się na przekazie wizualnym: użytkownicy mogą udostępniać zdjęcia czy grafiki w formie postów, krótkich filmów, stories czy organizować transmisje na żywo. Użytkownicy platformy tworzą profile, na których przedstawiają swoją codzienność, dzielą się przemyśleniami, opiniami czy wiedzą. Serwis umożliwia natychmiastową edycję treści, którą użytkownik chce opublikować, oferując setki filtrów zmieniających rysy twarzy, dodatkowe elementy, tła, ale również muzykę, która jest zgodna z aktualnymi trendami. Użytkownicy Instagrama tworzą społeczności, obserwując innych użytkowników, umożliwiają także obserwowanie treści, które sami publikują, zachęcając innych do wchodzenia w interakcje z nimi. Każdy z użytkowników Instagrama może polubić treści publikowane przez innych użytkowników, pisać wiadomości prywatne do autora treści, komentować, zapisywać je, aby mieć później możliwość szybkiego powrotu, udostępniać innym użytkownikom czy tworzyć autorskie remiksy.

Koroner – urzędnik państwowy w Wielkiej Brytanii, którego jedną z kompetencjijest ustalanie powodu śmierci na podstawie zgromadzonych dowodów, zeznań świadków czy sekcji zwłok. Urząd koronera może prowadzić dochodzenie w sprawie śmierci, jeśli uzna to za konieczne, w tym także na wniosek rodziny zmarłej osoby. Koroner może publikować raporty i rekomendacje, których celem jest zapobieżenie kolejnym zgonom z podobnych do ustalonych przyczyn. W biurze koronera wydawane są orzeczenia i oceny.

Kryzys presuicydalny – określany również jako zespół przedsamobójczy; jest specyficznym stanem osób, które mają wrażenie znajdowania się w sytuacji bez wyjścia i niemożności uzyskania pomocy, których myśli i dążenia skierowane są na obszar samobójstwa. Osoba znajdująca się w kryzysie presuicydalnym przechodzi zazwyczaj przez dwie fazy – wyobrażeniową, której towarzyszą myśli samobójcze czy wyobrażenia własnej śmierci w różnych scenariuszach, oraz pragnieniową, skupioną wokół planowania aktu samobójstwa, porządkowania spraw i przygotowywania siebie na śmierć.

Meta Platforms –amerykański konglomerat technologiczny, założony przez Marka Zuckerberga (dziś pełni on funkcję prezesa) wraz z Eduardem Saverinem, Andrewem McCollumem, Dustinem Moskovitzem i Chrisem Hughesem. Oprócz serwisów społecznościowych Facebook i Instagram w posiadaniu Meta znajdują się m.in.: Messenger, WhatsApp, Giphy, Oculus czy FacebookWatch.

Pinterest –platforma społecznościowa, opierająca się na wizualnych pomysłach i inspiracjach, które zamieszczane są przez użytkowników. Użytkownicy mogą udostępniać, komentować i zapisywać filmy, zdjęcia, grafiki, pliki audio czy GIF-y (kilkusekundowa animacja).

Pin –zapisywane przez użytkowników Pinteresta filmy, zdjęcia, grafiki, pliki audio, GIF-y. Zgromadzone przez danego użytkownika piny tworzą jego tablicę.

Snapchat –aplikacja mobilna należąca do firmy Snap Inc., która służy do przesyłania wybranym znajomym zdjęć i filmików nazywanych „snapami”, a także udostępniania My Story, czyli materiału widocznego dla wszystkich obserwujących (podobnie jak stories na Instagramie). Dane na stronie creators.snap.com wskazują, że z aplikacji korzysta 293 mln aktywnych użytkowników na całym świecie, docierając do 90% osób w wieku 13–24 lata. Snapchat, podobnie jak Instagram, zachęca do podejmowania interakcji, umożliwia też urozmaicanie udostępnianych treści poprzez filtry czy podkład muzyczny.

Stories i IGTV –stories to krótkie treści wideo nagrywane przez użytkowników Instagrama, które znikają z profilu po 24 godzinach. Na stories użytkownicy nagrywają to, co aktualnie robią, gdzie są czy o czym myślą, sprawiając, że obserwatorzy uczestniczą w życiu danego użytkownika. IGTV umożliwia użytkownikom publikowanie dłuższych niż stories filmów.

Tweet/retweet –tweet to post, który użytkownik platformy X (dawniej Twitter) udostępnia na swoim profilu. Retweet to odpowiednik udostępnienia czyjegoś postu, z możliwością skomentowania go. Udostępnienie czyjegoś postu sprawia, że jest on widoczny dla obserwatorów danego użytkownika. Na tweety i retweety można odpowiadać, reagować, komentować je i udostępniać, podobnie jak na innych platformach społecznościowych.

Tablica (Pinterest) – sposób organizacji treści. Udostępniane przez użytkowników platformy Pinterest materiały zorganizowane są w tablice. W ustawieniach powiadomień każdy użytkownik może wyrazić zgodę na otrzymywanie powiadomień o korespondujących z jego zainteresowaniami materiałach z tablic innych użytkowników poprzez e-mail, aplikację czy powiadomienia typu push (komunikaty wyświetlane na urządzeniu, np. „Masz nową wiadomość w serwisie Pinterest” itp.). Jeden użytkownik może stworzyć do 500 tablic. Istnieje możliwość zarządzania widocznością tablic, udostępniając możliwość wglądu do nich wybranym użytkownikom.

X (dawniej Twitter) –platforma społecznościowa, której główną ideą jest formułowanie zwięzłych, jasnych i konkretnych komunikatów. Na początku działania platformy użytkownik mógł stworzyć tweet z liczbą do 140 znaków, dziś została ona podwojona. Funkcjonowanie na X różni się znacznie od korzystania z Instagrama czy Facebooka – serwis nie umożliwia tworzenia wizualnie rozbudowanych profili użytkowników (galerie zdjęć czy materiałów wideo). Główną zawartością platformy są krótkie tweety, wokół których niejednokrotnie toczą się dyskusje. Zmiana nazwy z Twitter na X nastąpiła 24 lipca 20024 roku.

Śmiertelnie niebezpieczne algorytmy mediów społecznościowych

Czy ekspozycja na negatywne treści w mediach społecznościowych może stać za podjęciem decyzji o powzięciu próby samobójczej przez nastolatkę cierpiącą na depresję? Niniejszy materiał jest pierwszym z serii dotyczących wpływu mediów społecznościowych na młodych ludzi i przybliża historię brytyjskiej nastolatki, Molly Rose Russell, która wpadła w sidła algorytmów Pinteresta, Twittera i Instagrama.

21 listopada 2017 roku koroner Andrew Walker wszczął dochodzenie w sprawie śmierci Molly Rose Russell, a 1 grudnia bieg rozpoczęło oficjalne śledztwo, które zakończyło się 30 września 2022 roku[1]. Ustalenia śledczych wykazały, że Molly Russell zmarła w wyniku aktu samookaleczenia, cierpiąc z powodu depresji oraz negatywnych skutków ekspozycji na treści online[2]. Orzeczenie urzędu koronera było zaskakujące dla opinii publicznej, ponieważ pewnym stopniem odpowiedzialności za śmierć nastolatki zostało obarczone środowisko mediów społecznościowych i platform streamingowych, w których nastolatka narażona była na treści zagrażające jej bezpieczeństwu i życiu. W trakcie przebiegu śledztwa ustalono, że sposób działania algorytmów platform, na których Molly posiadała konta oraz subskrybowała treści, umożliwiał wyświetlanie zdjęć, grafik, materiałów wideo czy tekstów dotyczących depresji, samookaleczeń i samobójstwa, które nie powinny być wyświetlane czternastoletniemu dziecku. Część materiałów pojawiła się bez intencji nastolatki – zarekomendowały je algorytmy, które zaskakująco doskonalone i szybko dobierają treści do zainteresowań użytkownika, dosłownie podsuwając posty, filmy i wpisy korespondujące tematyką do wcześniej wyświetlanych. Badania aktywności w mediach społecznościowych i platformach, na których Molly była aktywna, wskazały, że materiały proponowane do wyświetlania idealizowały samookaleczenia i samobójstwa, komunikowały, że podjęcie próby samobójczej jest naturalną drogą wyjścia ze stanu depresji, z którego nie można wyzdrowieć, zachęcały do izolowania się i wycofywania z relacji interpersonalnych. Część materiałów, które algorytmy podsyłały Molly, normalizowały jej pogarszający się stan psychiczny, ale zdarzały się również materiały zachęcające do poszukiwania pomocy (jak się później okazało, sposoby te miały znikome szanse na osiągnięcie sukcesu). Wydany po zakończeniu śledztwa raport wskazywał, że zagrażające treści, które Molly oglądała podczas aktywności w mediach społecznościowych, w bardziej niż minimalny sposób przyczyniły się do jej śmierci[3].

Molly Russell w momencie odebrania sobie życia w dniu 21 listopada 2017 roku miała 14 lat.Nastolatka cierpiała z powodu depresji, będąc znacznie bardziej podatną na różne zagrożenia obecne w jej najbliższym środowisku niż jej zdrowi rówieśnicy. Ciągła ekspozycja na szkodliwe treści wyświetlane w mediach społecznościowych nie sprzyjała zatem polepszaniu się stanu jej zdrowia psychicznego, ponieważ algorytmy platform społecznościowych ciągle rekomendowały jej treści zorientowane na depresję, samouszkodzenia i samobójstwo. W jednym ze spotkań biegłych, powołanych przez koronera Walkera do śledztwa, brał udział psychiatra dziecięcy, który określił materiały oglądane przez Molly jako wysoko niepokojące i stresujące, mogące powodować trudności w radzeniu sobie z ich przekazem nawet przez osoby dorosłe[4]. Podczas prezentacji filmów o samobójstwach, zapisanych na profilu instagramowym Molly, salę opuszczali dorośli, którzy byli na niej obecni, ponieważ ich treść była zbyt drastyczna. W ciągu 6 miesięcy poprzedzających decyzję o zakończeniu życia Molly polubiła, udostępniła lub zapisała[5] 16 300 filmików lub postów na Instagramie, z czego 2100 związanych było bezpośrednio z drastycznymi samookaleczeniami, depresją i samobójstwami[6]. Analiza aktywności nastolatki w różnych serwisach społecznościowych wykazała, że przez pół roku poprzedzające jej śmierć tylko przez 12 dni nie angażowała się w tematykę związaną z zagrażającymi treściami[7]. Jej tablica na Pintereście zawierała 469 zdjęć nawiązujących do samookaleczeń, depresji i samobójstwa, Molly dostawała powiadomienia z serwisu typu 10 tablic dotyczących depresji, które mogą Ci się spodobać ale również Depresyjna dziewczyna czy 10 sposobów na wyzdrowienie z depresji[8]. Nastolatka zapisała 5793 pinów innych użytkowników, których tematyka nawiązywała do depresji, samookaleczeń i samobójstwa[9].

Śledczy porównali treści, które Molly oglądała i zapisywała zanim zainteresowała się obszarem samouszkodzeń, depresji i samobójstw – związane były z jej zainteresowaniami, muzyką i filmami dla dzieci i młodzieży. Będąc już w depresji, nastolatka obejrzała 138 filmów i seriali, które swoją tematyką nawiązują do głębokiej depresji, samookaleczeń i samobójstw, m.in. serial Trzynaście powodów (13 Reasons Why), którego premiera w USA odbyła się w marcu 2017 roku[10]. Serial, będący ekranizacją książki Jaya Ashera, ukazuje historię nastolatki, która popełniła samobójstwo, zostawiając wybranym znajomym ze szkoły 13 nagranych kaset magnetofonowych – każda z nich dotyczyła jednej osoby, która w znaczący sposób przyczyniła się do podjęcia tragicznej w skutkach decyzji[11]. Odcinek, w którym dziewczyna popełnia samobójstwo, zawiera sceny wiernie oddające tragizm sytuacji. Serial reklamowano jako przedstawiający prawdziwe problemy współczesnych nastolatków – nadużywanie alkoholu, uzależnienie od substancji psychoaktywnych, przeżywanie traumy związanej z napaściami seksualnymi oraz samobójstwami. Zamierzeniem twórców było ukazanie świata młodych ludzi bez filtrów i kompromisów, co miało nieść walor edukacyjny dla jego odbiorców. Serial otworzył przestrzeń do medialnej dyskusji o kondycji psychicznej i doświadczeniach współczesnych nastolatków, jednak towarzyszyła temu ogromna fala krytyki wielu krajowych i międzynarodowych organizacji, które zajmują się obszarem zdrowia psychicznego oraz profilaktyką samobójstw czy samookaleczeń wśród młodzieży. Międzynarodowe Stowarzyszenie Zapobiegania Samobójstwom (International Association for Suicide Prevention, IASP) opublikowało oświadczenie[12], w którym wyrażono zaniepokojenie możliwym negatywnym wpływem treści serialu na młodych ludzi, pozostających obecnie są w kryzysie presuicydalnym lub zmagających się z trudnościami psychicznymi i mogących utożsamiać się z bohaterką serialu. IASP poddaje w wątpliwość wiele elementów serialu, które mogą wpływać na kondycję psychiczną oglądających go dzieci i nastolatków[13], m.in.:

- podawanie konkretnych szczegółów metod stosowanych przez osoby podejmujące próby samobójcze i ukazywania ich w silnie działający na wyobraźnię sposób, co stwarza zagrożenie wystąpienia zjawiska naśladownictwa;

- elementy gloryfikowania i romantyzowania zjawiska samobójstwa, co może nie być bez wpływu na osoby bezbronne ze względu na aktualny stan psychiczny lub rozważające podjęcie próby samobójczej czy samookaleczające się;

- upamiętnianie bohaterki przez uczniów szkoły, do której chodziła, np. sceny robienia sobie selfie przed szkolną szafką, udekorowaną pamiątkami o niej, co może być błędnie interpretowane przez młodych ludzi, którzy rozważają samobójstwo (wywoływanie myśli: „Jeśli odbiorę sobie życie, wszyscy będą o mnie mówić i pamiętać”);

- racjonalizowanie samobójstwa jako jedynego wyjścia/ucieczki z trudnej sytuacji, co upraszcza zjawiska, które leżą u podstaw kryzysu presuicydalnego, samookaleczeń czy depresji, przez co odbiorcy serialu mogą zacząć postrzegać odebranie sobie życia jako reakcję na zastraszanie przez rówieśników czy konflikty z dorosłymi (twórcy serialu nie wskazują na inne, dostępne i skuteczne sposoby interwencji w sytuacji kryzysowej).

Tygodnik „Journal of the American Medical Association” („JAMA”), wydawany przez Amerykańskie Towarzystwo Medyczne, opublikował wyniki quasi-eksperymentu, który wykazał, że po premierze serialu Trzynaście powodów wyszukiwanie frazy „jak popełnić samobójstwo” było 26% częstsze, frazy „zapobieganie samobójstwom” – 23% częstsze, a frazy „numer infolinii dla samobójców” – o 21% częstsze w stosunku do wyników wyszukiwania przed premierą[14]. Biorąc pod uwagę wyżej wskazane informacje, które stanowią tylko ułamek danych o kontrowersyjnym wpływie serialu na osoby zagrożone podjęciem próby samobójczej czy będących w złej kondycji psychicznej, jego wpływ na plany i samopoczucie Molly mógł być niekorzystny i odwrotny do zamierzonego przez jego twórców.

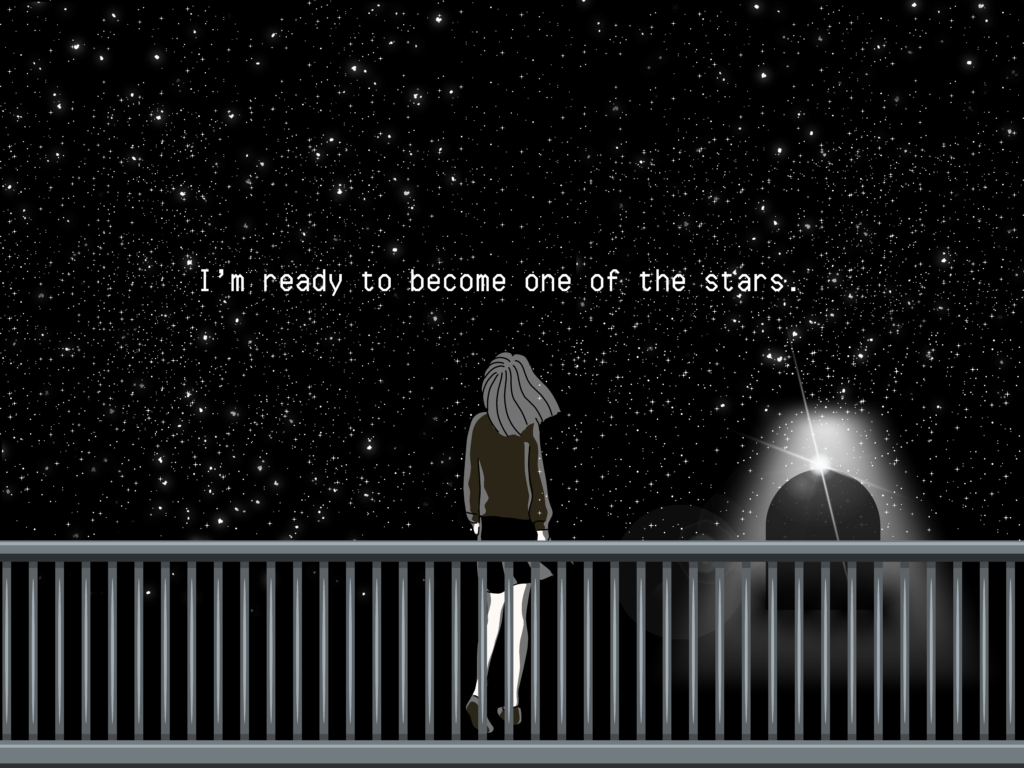

Telefon Molly, którego używała przez większość czasu spędzanego w internecie, został zbadany przez śledczych, którzy oprócz tysięcy niepokojących treści znaleźli również konto w serwisie Twitter (obecnie X), o którym nie wiedzieli jej rodzice. Nastolatka miała konto na Twitterze, na którym pojawiały się tweety i retweety dotyczące braku sensu istnienia, samotności i możliwości odebrania sobie życia, będąc pamiętnikiem pogarszającego się stanu jej zdrowia[15]. Zdjęciem w tle na Twitterze Molly była grafika dziewczyny, odwróconej tyłem do obserwatora, stojącej za barierkami (podobnie jak osoba mająca za chwilę skoczyć z mostu), zwróconej ku światłu nad rodzajem wejścia/drzwi. Na grafice widniał napis: „Jestem gotowa, by stać się jedną z gwiazd”[16].

Pierwszy wpis Molly to retweet postu o depresji (post został pierwotnie zamieszczony przez nastoletniego użytkownika, który zmagał się z depresją, samookaleczeniami i stanami lękowymi; jego konto obserwowało ponad 200 000 osób), zamieszczony 27 grudnia 2016 roku, który brzmiał: „Jestem zmęczony byciem niechcianym i bezradnym. Nawet pośród przyjaciół, którzy mnie otaczają, czuję się wyrzutkiem”[17]. Ojciec Molly w trakcie śledztwa[18] przyznał, że nazwa jej profilu na Twitterze – „idfc_nomore” – oznaczała prawdopodobnie „I don’t f****** care no more”, co przetłumaczyć można jako: „Już mnie to k**** nie obchodzi”[19]. Nastolatka, oprócz zamieszczania tweetów i retweetowania wpisów innych użytkowników, szukała pomocy poprzez Twittera – od lipca 2017 roku pisała wiadomości do:

- młodej amerykańskiej aktorki Lili Reinhart[20] o treści: „Nie mogę już tego znieść. Muszę się z kimś skontaktować, po prostu nie mogę tego znieść”[21];

- autorki serii książek o Harrym Potterze J.K. Rowling (15 października 2017 roku): „@jk_rowling od jakiegoś czasu mam myśli samobójcze, ale moją ucieczką jest czytanie HP i świata, który stworzyłaś”[22];

- youtuberki Salice Rose – pisała: „Nie mogę już tego robić. Poddaję się”, „Nie pasuję do tego świata. Wszystkim będzie lepiej beze mnie…”[23].

Molly miała świadomość swojego pogarszającego się samopoczucia, czuła się zapewne coraz bardziej zdesperowana i zagubiona, dlatego wysyłała wiadomości do osób, z którymi mogła czuć więź – autorki serii książek, które przynosiły jej ukojenie, aktorki, która mówiła otwarcie o zmaganiach z depresją, czy youtuberki, która nagrywała materiały o podjętych próbach samobójczych i procesie zdrowienia z depresji[24]. Zastanawiające jest, dlaczego Molly nie podjęła prób uzyskania pomocy w bliskim i znanym jej środowisku – u rodziny, w szkole czy u zaufanej osoby – jednak trudno jest rozważać możliwe odpowiedzi na to pytanie i kwestionować wybory pogrążonej w depresji i kryzysie presuicydalnym nastolatki.

Ojciec wyrażał swoje zaniepokojenie pogłębiającym się wycofaniem córki, jednak Molly miała twierdzić, że przechodzi właśnie przez jedną z faz swojego życia[25], co można było uznać za komunikat typowy dla czternastolatki. Rodzina dziewczynki zauważyła zmianę w trakcie roku, który poprzedzał tragiczne wydarzenie – Molly wycofała się, samotnie spędzając większą część wolnego czasu, co również zostało uznane za zachowanie typowe dla nastolatki. Działania i komunikaty Molly były jednak cichym odzwierciedleniem treści, które otaczały ją w świecie online, silnie oddziałującym na jej psychikę, co wyszło na jaw zbyt późno.

Czy tragiczna historia Molly Rose Russell jest tylko jedną z wielu podobnych, zdarzających się na całym świecie? Ian Russell, ojciec Molly, stwierdził, że Meta prowadziła jego córkę „obłąkanym szlakiem wysysających życie treści”[26], co było zarzutem dla sposobu działania algorytmu rekomendacji treści podobnych do wcześniejszych preferencji i aktywności użytkownika oraz braku kontroli nad materiałami prezentowanymi dzieciom i młodzieży. Ojciec wskazał również, że giganci mediów społecznościowych interesują się wyłącznie monetyzacją generowanych zasięgów, jednocześnie pomijając obszar bezpieczeństwa i cierpienia, jakie powodują zagrażające treści proponowane przez algorytm osobom, które z różnych przyczyn są na nie bardziej podatne. Znamienna jest wypowiedź ojca Molly, odnosząca się do mediów społecznościowych i miejsc w internecie, które są zagrażające dla dzieci i nastolatków:

„To świat, którego nie rozpoznaję. To getto świata online, w które jeśli wejdziesz raz, to algorytm sprawi, że nie możesz uciec, ciągle polecając kolejne treści. Z tego świata nie ma ucieczki”[27].

W celu pozyskania informacji o działaniu platform Meta oraz Pinterest względem niepełnoletnich użytkowników wyżsi szczeblem przedstawiciele firm zostali wezwani do osobistego stawienia się w Londynie, aby złożyć zeznania przed urzędem koronera we wrześniu 2022 roku.

Z ramienia Meta przybyła dyrektor ds. polityki, zdrowia i dobrego samopoczucia w Meta Elisabeth Lagone, która przyznała, że choć niektóre posty i filmy prezentowane Molly naruszały wytyczne Instagrama zabraniające gloryfikowania, promowania i zachęcania do samookaleczeń i samobójstw, to w zasadzie są dopuszczalne ze względu na podnoszenie świadomości na temat stanu psychicznego użytkowników[28]. Stwierdziła, że spośród zaprezentowanych jej postów i filmów, które na Instagramie widziała Molly, co najmniej dwa naruszały obowiązujące ówcześnie na platformie zasady, jednak większość materiałów była bezpieczna i mogła być pokazywana użytkownikom w jej wieku, co stało w sprzeczności z sugestią obrońcy rodziny Russell, który uporczywie wskazywał na zagrożenia związane z niekontrolowanym wyświetlaniem się trzynasto- czy czternastoletnim dzieciom materiałów o samookaleczeniach i samobójstwie[29]. Przedstawicielka Meta oświadczyła, że wpływ treści związanych z depresją, samookaleczeniami i samobójstwem na najmłodszych użytkowników Instagrama nigdy nie był poddawany badaniom. Lagone zapewniła, że władze Meta dopilnują, aby korzystanie z Instagrama było pozytywnym i bezpiecznym doświadczeniem dla wszystkich użytkowników, szczególnie najmłodszych[30].

W imieniu Pinterest przed urzędem koronera stawił się dyrektor ds. działań społecznych Pinterest Judson Hoffman, który przyznał, że treści prezentujące samookaleczenia i samobójstwa naruszają zasady firmy i powodują, że jest ona mniej bezpieczna niż powinna być, a sprawa Molly ukazała niedoskonałość zasad bezpieczeństwa platformy[31]. Hoffman stwierdził, że postów, które Molly oglądała na Pintereście przed śmiercią, na pewno nie pokazałby własnym dzieciom[32].

W raporcie, który ukazał się po zakończeniu śledztwa, starszy koroner Andrew Walker zawarł sekcję z zaleceniami mającymi na celu ograniczać przyszłe zgody spowodowane treściami w mediach społecznościowych. Ich głównymi adresatami były konglomeraty technologiczne: Meta, X, Pinterest, Snapchat oraz rząd brytyjski[33]. Koroner Walker skupił się na sześciu obszarach, które powinny być bezzwłocznie uregulowane prawnie, aby poprawić bezpieczeństwo dzieci i młodzieży w sieci[34]. Zaproponował:

- oddzielne platformy społecznościowe dla dzieci i dorosłych;

- skuteczną weryfikację wieku przed zarejestrowaniem konta na platformie;

- kontrolę nad dostosowaniem dostarczaniem treści do wieku odbiorców;

- kontrolę nad algorytmem, który rekomenduje treści dla dzieci i młodzieży;

- przegląd i weryfikację reklam, które wyświetlają się w trakcie korzystania z mediów społecznościowych;

- kontrolę rodziców/opiekunów nad materiałami, do których dzieci i młodzież mają dostęp, które udostępniają i zapisują na urządzeniach.

Czy zalecenia koronera Walkera, które są bardzo aktualne i trafne, mają szansę na bycie wziętymi pod uwagę w Wielkiej Brytanii, krajach Unii Europejskiej (UE) czy w innych państwach? Warto wspomnieć, że od 25 sierpnia br. w krajach UE obowiązują nowe przepisy unijnego aktu o usługach cyfrowych (DSA – Digital Services Act), który ma chronić bezpieczeństwo w przestrzeni cyfrowej poprzez dbanie o podstawowe prawa użytkowników, ze szczególną uwagą kierowaną na osoby nieletnie[35]. TikTok oraz YouTube do 30 listopada 2023 roku powinny udzielić Komisji Europejskiej odpowiedzi na pytanie, w jaki sposób nieletni użytkownicy są chronieni przed zagrażającymi ich zdrowiu fizycznemu i psychicznemu treściami[36]. Meta Platforms oraz Snap Inc. powinny odpowiedzieć na podobne pytanie do 1 grudnia[37]. Czas pokaże, czy giganci mediów społecznościowych pochylą się nad pytaniami Komisji Europejskiej, ale co ważniejsze – nad bezpieczeństwem funkcjonowania dzieci i młodzieży na ich platformach.

[1] Regulation 28 Report To Prevent Future Deaths, North London Coroner’s Service, https://www.judiciary.uk/wp-content/uploads/2022/10/Molly-Russell-Prevention-of-future-deaths-report-2022-0315_Published.pdf, 19.11.2023.

[2] „Molly Rose Russell died from an act of self-harm whilst suffering from depression and the negative effects of on-line content”. Ibidem.

[3] Molly Russell inquest findings, 30.09.2022, https://www.nspcc.org.uk/about-us/news-opinion/2022/response-molly-russell/, 18.11.2023.

[4] A. Satariano, British Ruling Pins Blame on Social Media for Teenager’s Suicide, 1.10.2022, https://www.nytimes.com/2022/10/01/business/instagram-suicide-ruling-britain.html, 21.11.2023.

[5] W trakcie przeglądania treści publikowanych w aplikacjach społecznościowych istnieje możliwość zapisywania danego postu/filmu, co umożliwia wrócenie do niego w dowolnej chwili poprzez odpowiednią zakładkę w koncie użytkownika.

[6] D. Milmo, ‘The bleakest of worlds’: how Molly Russell fell into a vortex of despair on social media, 30.09.2022, https://www.theguardian.com/technology/2022/sep/30/how-molly-russell-fell-into-a-vortex-of-despair-on-social-media, 17.11.2023.

[7] K. Beioley, C. Criddle, Social media content ‘likely’ to have contributed to Molly Russell’s death, 30.09.2022, https://www.ft.com/content/3f9e7abc-9fbd-4339-ab11-dac16aac91e3, 18.11.2023.

[8] T. Hussey, Pinterest apologises after schoolgirl Molly Russell, 14, killed herself after looking at suicide posts online, 22.09.2022, https://www.newsbreak.com/news/2757418622478-pinterest-apologises-after-schoolgirl-molly-russell-14-killed-herself-after-looking-at-suicide-posts-online, 18.11.2023.

[9] A. Belanger, Coroner lists Instagram algorithm as contributing cause of UK teen’s death [Updated], 30.09.2022, https://arstechnica.com/tech-policy/2022/09/coroner-lists-instagram-algorithm-as-contributing-cause-of-uk-teens-death/, 24.11.2023.

[10] K. Mahadik, Molly Russell Suicide Inquest: Did a UK Teen Pay the Price for Big Tech Apathy?, 6.10.2022, https://www.thequint.com/explainers/molly-russell-suicide-case-why-all-fingers-point-to-social-media-platforms, 17.11.2023.

[11] Polska wersja serwisu streamingowego Netflix zaleca oglądanie serialu użytkownikom w wieku 16+. Trzynaście powodów, https://www.netflix.com/pl/title/80117470, 26.11.2023.

[12] Briefing In Connection With The Netflix Series ’13 Reasons Why’, https://suicydologia.org/wp-content/uploads/2017/05/Briefing-in-connection-with-the-Netflix-series-13-Reasons-Why.pdf. Oświadczenie zostało opublikowane również przez Polskie Towarzystwo Suicydologiczne.

[13] Ibidem.

[14] J.W. Ayers, PhD, et al., Internet Searches for Suicide Following the Release of 13 Reasons Why, 10.2017, https://jamanetwork.com/journals/jamainternalmedicine/fullarticle/2646773, 21.11.2023.

[15] Pinterest apologises after schoolgirl…

[16] „I’m ready to become one of the stars”. In her own words – Molly Russell’s secret Twitter account, 20.09.2022, https://www.bbc.com/news/uk-62892636, 23.11.2023.

[17] „I’m so tired of being unwanted and helpless. Even with friends surrounding me I feel like an outcast. – rc’. Ibidem.

18 https://www.coronersociety.org.uk/faqs/, 18.11.2023.

[19] J. Wright, ’The world you created is my escape’: Tragic Molly Russell’s tweet to JK Rowling as coroner says 14-year-old 'turned to celebrities for help not realising there was little chance of a reply’ before she killed herself, 30.09.2022, https://www.dailymail.co.uk/news/article-11267723/Molly-Russells-tweet-JK-Rowling-coroner-says-14-year-old-turned-celebrities-help.html, 18.11.2023.

[20] Amerykańska aktorka, która zasłynęła jedną z głównych ról w serialu dla młodzieży „Riverdale”, zmagała się z depresją i otwarcie mówiła, że w pewnym momencie życia czuła się, jakby weszła do czarnego tunelu, z którego nie mogła wyjść.

[21] „I can’t take it any more. I need to reach out to someone, I just can’t take it”, Pinterest apologises after schoolgirl… op.cit.

[22] „@jk_rowling my mind has been full of suicidal thoughts for a while but reading HP and the world you created is my escape”. ’The world you created is my escape’…

[23] „I can’t do it anymore. I give up”, „I don’t fit in this world. Everyone is better off without me…”. Ibidem.

[24] „Overcoming Suicidal Thoughts”. https://www.youtube.com/watch?v=kHcxf_7URr4, 26.11.2023.

[25] Ibidem.

[26] „Demented trail of life-sucking content”. D. Milmo, Social media firms ‘monetising misery’, says Molly Russell’s father after inquest, 30.11.2022, https://www.theguardian.com/uk-news/2022/sep/30/molly-russell-died-while-suffering-negative-effects-of-online-content-rules-coroner, 19.11.2023.

[27] „It’s a world I don’t recognise. It’s a ghetto of the online world that once you fall into it, the algorithm means you can’t escape it and it keeps recommending more content. You can’t escape it”. M. Robinson FCA, Should we feel more excited or scared about AI? Or both!, 7.11.2023, https://www.britsafe.org/safety-management/2023/should-we-feel-more-excited-or-scared-about-ai-or-both, 17.11.2023.

[28] D. Milmo, Meta executive apologises over inappropriate content seen by Molly Russell, 26.09.2022, https://www.theguardian.com/uk-news/2022/sep/26/posts-seen-by-molly-russell-of-self-harm-and-suicide-safe-for-children-meta-says, 24.11.2023.

[29] Ibidem.

[30] Ibidem.

[31] J. Payne, Boss admits Pinterest ‘not safe’ when Molly Russell used site before ending life, Boss admits Pinterest ‘not safe’ when Molly Russell used site before ending life, 22.09.2022, https://finance.yahoo.com/news/boss-admits-pinterest-not-safe-162848948.html?ocid=msedgntp%2Cmsedgntp&guccounter=1&guce_referrer=aHR0cHM6Ly93d3cuZ29vZ2xlLmNvbS8&guce_referrer_sig=AQAAAAgeTr73bzu5UETp2PVxf4biWUWE4gvT5ojPOFg73NquSThsLXhX6AzwRFHmu9POTpbzV8D6TMfdSwmfgUtFz__rGMXO9T5E5zzDJg_GDHnD6bukuySipoIoVpD7942pyuIp88NvWYYI4g2Kjpgm6svUpS_Tqo6xGtZI4Rzb4WdE, 24.11.2023.

[32] Ibidem.

[33] Molly Russell: Coroner’s report urges social media changes, 14.10.2022, https://www.bbc.com/news/uk-england-london-63254635, 17.11.2023.

[34] Ibidem.

[35] Pakiet aktu prawnego o usługach cyfrowych, https://digital-strategy.ec.europa.eu/pl/policies/digital-services-act-package, 24.11.2023.

[36] YouTube, TikTok must detail child protection measures by Nov 30, EU says, 9.11.2023, https://www.reuters.com/technology/cybersecurity/youtube-tiktok-must-detail-child-protection-measures-by-nov-30-eu-says-2023-11-09/, 24.11.2023.

[37] Meta and Snap must detail child protection measures by Dec. 1, EU says, 10.11.2023, https://www.reuters.com/technology/meta-snap-must-detail-child-protection-measures-by-dec-1-eu-says-2023-11-10/, 24.11.2023.